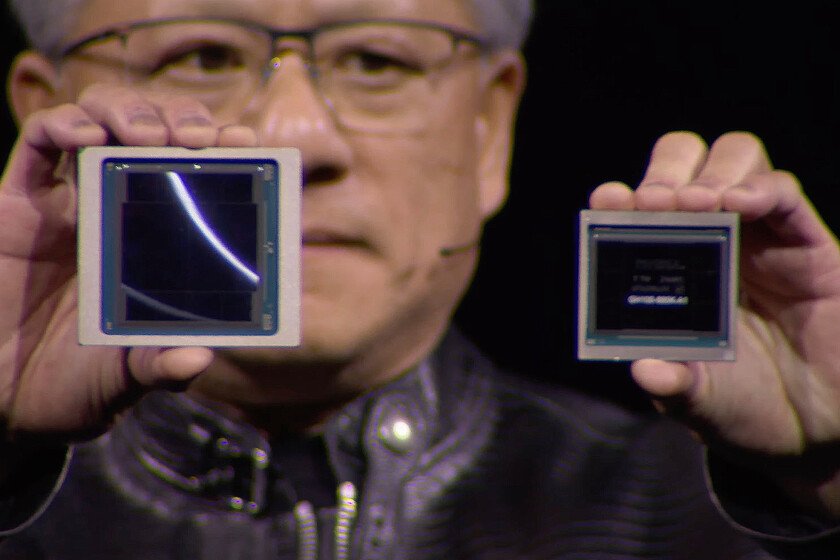

Jensen Huang estaba en su elemento ayer. Consciente de que actualmente los competidores todavía están luchando por ganar terreno, presentó —entre otras cosas— sus nuevos chips de inteligencia artificial, los B200 con arquitectura Blackwell.

Estos monstruos de la computación dan un salto cuantitativo claro: de los 80.000 millones de transistores de sus prestigiosos H100 con arquitectura Hopper pasan ahora a los 208.000 millones de transistores. Eso los hace 2,5 veces más potentes que sus predecesores, convirtiéndolos en productos muy demandados en esta era de la IA donde la capacidad de procesamiento marca la diferencia.

El evento GTC 2024 de NVIDIA dejó otras novedades importantes como Earth-2, para analizar la meteorología, Project GROOT para robots humanoides o su nueva plataforma de simulación cuántica.

Todo prometedor y confirma el interés de la empresa en seguir dominando en los centros de datos. Sin embargo, NVIDIA parece olvidar a los usuarios.

De hecho, es sorprendente que no haya novedades relacionadas con la ejecución de aplicaciones de IA en local, una parte importante del desarrollo de la inteligencia artificial.

Los fabricantes están aprovechando la IA como argumento de venta en sus dispositivos. Aunque por ahora las funciones son relativamente modestas, todo apunta a que irán evolucionando.

Para esto, contar con chips especializados sería importante. Es razonable pensar en tarjetas aceleradoras de IA para este tipo de aplicaciones.

Ese nodo de computación Blackwell cuenta con dos CPUs Grace y cuatro de las nuevas GPUs B200 con arquitectura Blackwell. Su rendimiento e IA puede llegar a los 80 petaFLOPS según la empresa. Una absoluta barbaridad.

NVIDIA tiene una oportunidad magnífica para hacerse indispensable en diversos dispositivos, pero parece no tener soluciones en ese sentido.

Esta cuestión la inició hace meses Groq, una startup que diseñó chips de IA llamados LPUs especializados en el procesamiento del lenguaje, aceleradores de ChatGPT.

Su propuesta es interesante, abriendo las puertas a tener un LPU para interactuar con chatbots de forma rápida.

En NVIDIA no parecen interesados en este sector por el momento, a pesar de su posición para plantear soluciones.

Quizás recuerden su anterior aventura con los chips NVIDIA Tegra, SoCs centrados en el procesamiento multimedia eficiente.

El Tegra X1 fue utilizado en consolas como la NVIDIA Shield y Nintendo Switch, pero desde entonces no ha habido mejoras aparentes.

La empresa podría haber lanzado una propuesta en este sentido, pero parece enfocada en las tarjetas gráficas y chips para IA.

Es cuestión de tiempo saber si fue un error no incursionar en chips aceleradores de IA para dispositivos cotidianos.

Supermicro es un actor importante en el crecimiento de la IA, superando a NVIDIA en crecimiento.